摄像头是ADAS的核心传感器。与毫米波雷达和激光雷达相比,最大的优势在于识别(物体是汽车还是人,标志牌是什么颜色)。汽车行业对价格敏感,摄像头硬件的成本相对较低。由于近年来计算机视觉的快速发展,从相机角度切入ADAS感知的初创公司数量也非常可观。

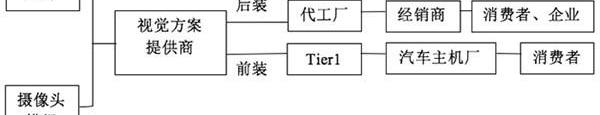

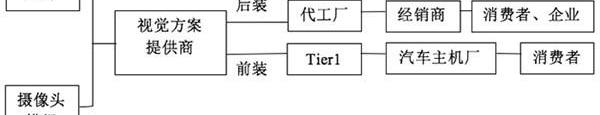

这些初创公司可以统称为视觉解决方案提供商。他们掌握核心视觉传感器算法,为下游客户提供包括车载摄像头模块、芯片和软件算法在内的全套解决方案。在预安装模式下,视觉解决方案提供商扮演第二级供应商的角色,与Tier1合作为OEM定义产品。在安装后的模式中,除了提供一套完整的设备外,还有一种出售算法的模式。

本文将分析视觉ADAS的功能、硬件要求和评估标准,并在《[车云报告]ADAS视觉解决方案简介盘点(第二部分)》中参考Mobileye对国内11家初创公司的产品进行详细解读。

视觉ADAS供应链系统

首先,视觉ADAS可以实现功能

由于安全记录和停车的需要,汽车中使用了大量的摄像头作为行车记录仪和倒车影像等辅助功能。通常,图像由安装在车身各个位置的广角摄像头采集,经过校准和算法处理后,生成或拼接图像形成视图,以补充驾驶员的视觉盲点,而不涉及车辆控制,因此更注重视频处理,技术已经成熟并逐渐普及。

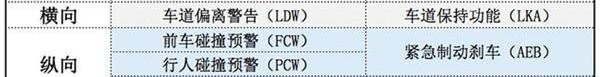

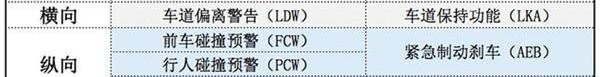

目前,在驾驶辅助功能中,摄像头可以独立实现许多功能,并根据自动驾驶的发展规律逐步进化。

这些功能更加强调对输入图像的处理,从拍摄的视频流中提取有效的目标运动信息进行进一步分析,给出预警信息或直接调动控制机制。与视频输出功能相比,它强调高速下的实时性能,这部分技术正处于发展的上升期。

第二,视觉ADAS的软硬件要求

视觉系统ADAS产品由软件和硬件组成,主要包括摄像头模块、核心算法芯片和软件算法。在硬件方面,应考虑驾驶环境(振动、高低温等),大前提是满足车辆法规的要求。

(1) 车载ADAS摄像头模块

车载ADAS摄像头模块需要定制化开发。为了满足全天候车辆的需求,当明暗对比度太大(进出隧道)时,通常需要平衡图像中太亮或太暗(宽动态)的部分。对光敏感(高灵敏度),避免给芯片带来太大压力(不要盲目追求高像素)。

摄像头模块是基础。就像一张有着良好基础的照片一样,也有美化的空间。在保证拍摄到的图像足够的基础上,该算法可以更好地发挥作用。

此外,在参数方面,ADAS和行车记录仪对摄像头有不同的要求。用于行车记录仪的摄像头需要看到汽车前部周围尽可能多的环境信息(后视镜看着两个前轮,水平视角约为110度)。ADAS的摄像头更注重为驾驶预留更多的判断时间,需要看得更远。与相机镜头的广角和长焦类似,这两个参数不可能同时存在,ADAS只能在选择硬件时进行平衡。

(2) 核心算法芯片

图像相关算法对计算资源的要求很高,因此芯片的性能也很特殊。如果在算法上叠加深度学习来帮助提高识别率,那么对硬件性能的要求只会增加,主要性能指标是操作速度、功耗和成本。

目前,ADAS中使用的大多数芯片……

eras被外国垄断,主要供应商有瑞萨电子、ST微电子(ST)、自由规模、亚德诺(ASIC)、德州仪器(TI)、恩智浦、富士通、赛灵思、英伟达等。

ARM、DSP、ASIC、MCU和SOC是软件编程的嵌入式方案。与嵌入式系统相比,FPGA具有更快的处理速度,因为它直接对硬件进行编程。

GPU和FPGA具有较强的并行处理能力。对于图片之类的文本,尤其是在使用深度学习算法时,需要多个像素同时计算,FPGA和GPU将具有更多优势。这两种芯片的设计思想相似,都是为了处理大量简单重复的操作而设计的。GPU的性能更强,但能耗更高。由于FPGA的编程和优化是直接在硬件层面进行的,因此能耗会低得多。

因此,FPGA被认为是一种流行的平衡算法和处理速度的方案,尤其是当它用于预安装并且算法稳定时。FPGA是一个不错的选择。但与此同时,FPGA的技术要求也很高。原因是计算机视觉算法是用C语言编写的,FPGA硬件语言是verilog。这两种语言是不同的,所以将算法移植到FPGA的人应该有软件背景和硬件背景。在人才最昂贵的今天,这是一个不小的成本。

目前,可以用于传统计算机视觉算法的车规芯片有很多选择,但适合传统算法和深度学习算法的低功耗、高性能芯片还没有真正出现。

(3) 算法

ADAS视觉算法的来源是计算机视觉。

传统的物体计算机视觉识别大致可以分为几个步骤:图像输入、预处理、特征提取、特征分类、匹配和完全识别。

有两个特殊的地方依赖于专业经验:第一个是特征提取。识别障碍物时有许多可用的功能,功能设计尤其重要。要判断前方的障碍物是否是汽车,参考特征可能是汽车的尾灯,也可能是汽车底盘在地面上投射的阴影。二是预处理和后处理。预处理包括输入图像的噪声平滑、对比度增强和边缘检测。后处理是指对分类和识别结果候选者进行后处理。

科学研究中的计算机视觉算法模型在应用于实际环境时可能表现不佳。由于科学研究获得的算法会增加天气、复杂路况等条件,在现实世界中,除了要注意算法在复杂环境中的性能外,还要考虑算法在各种环境中的鲁棒性(稳定性)。

算法的一个重要变化是深度学习的渗透。

深度学习使计算机能够模拟人类思维的神经网络,并能够自行学习和判断。通过将校准后的原始数据直接输入计算机,例如选择一堆异形汽车的图片,然后将其扔到计算机中,它可以自己学习汽车是什么。这样,可以省去计算视觉特征提取和预处理的步骤,将感知过程简化为输入图片和输出结果两个步骤。

业内一致认为,在感知方面,深度学习将在角落里超越传统的视觉算法。目前,深度学习的算法模型已经开源,算法种类不多,因此有可能降低阈值,并产生大量优秀的结果。然而,由于缺乏合适的汽车平台,距离商业化还有很长的路要走。

业界对深度学习在ADAS中的应用的看法是客观而冷静的。许多人认为深度学习算法是Blackbox算法,类似于人类感知决策的过程,可以快速输出结果,因此很难在事故发生后检查原因。因此,在使用深度学习时应添加理性决策,并将设计划分为多个块。

还有一种观点认为,传统的计算机视觉算法比我们想象的更智能,它也可以检测到……中的一些异形车辆……

不断寻找车辆图片的相似性和差异性的过程。并且在叠加深度学习算法后,传统的计算机视觉算法也可以帮助减少深度学习神经网络的层数,简化算法。

可以肯定的是,无论哪种算法,数据都是训练和测试的宝贵资源,而且不是简单地说越多越好,而是越有效越好(符合实际的汽车环境并确保多样化)。

(4) 不同的摄像机平台

单眼和双目

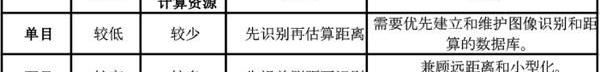

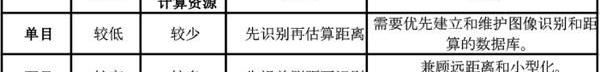

为了完成ADAS任务,视觉方案通常需要实现两项任务:测距(车辆与前方障碍物之间的距离)和识别(障碍物是什么)。根据汽车摄像头模块的不同,目前主流的ADAS摄像头可以分为单眼和双目两种技术路线。

单眼相机的算法思想是先识别后测距:首先通过图像匹配进行识别,然后根据图像大小和高度进一步估计障碍物和车辆时间。在识别和估计阶段,有必要与已建立的样本数据库进行比较。如果你想识别各种汽车,你需要建立一个车型数据库,如果你想鉴定麋鹿,你需要创建一个麋鹿数据库。

双目摄像机的算法是先测距后识别:首先,通过视差直接测量物体和汽车之间的距离,原理与人眼相似。当两只眼睛看着同一个物体时,会有视差,也就是说,当他们闭上左眼和右眼看物体时,他们会发现感觉位移。这种位移可以进一步测量目标物体的距离。然后,在识别阶段,双目仍然需要使用与单眼相同的特征提取和深度学习算法来进一步识别障碍物。

因为视差越远,视差就越小。业内有观点认为,双目在20米以内具有明显的测距优势,在20米以外很难减少视差测距。我们可以使用高像素相机和更好的算法来提高测距性能,这是难点和核心竞争力。

双目透镜间距和距离测量是两个权衡参数。透镜间距越小,检测距离越近,透镜间距越大,检测距离就越远。考虑到汽车的美观性和ADAS的需求,小型远程双目产品更受欢迎。

由于增加一个镜头会带来更多的计算量,因此整个相机模块的性能要求和成本都更高。此外,在两者的校准工作中,双目比单眼更为复杂。

此外,选择双目方案切入市场并不能完全绕过单眼方案的难度。在第二阶段,您仍然需要一个庞大的数据库并完善算法。

单眼对比

多摄像头方案

除了一台双目望远镜外,还有一个由多台摄像机组成的平台。在一些方案中,选择长焦和广角相机与ADAS主相机配合,兼顾周围环境和远处物体检测。例如,Mobileye方案将在下面介绍。

也有ADAS功能叠加在全景平台上的情况。例如,对于环视进行车道偏离警告(LDW),与单目实现该功能相比,它具有一定的优势。在大雨或前方光源强的情况下,前视摄像头可能看不清车道线,摄像头可以斜向下看车道线并提供多个角度,基本不受地面水反射的影响,其功能可以比前视摄像头更稳定。但同时,我们也要考虑在侧面没有大灯的情况下摄像头的夜间表现。

这些方案与单眼在技术路线上没有本质区别。它们更多地基于不同的平台,充分发挥不同类型相机模块的优势来分配任务,或者提供更多的视角来解决单眼在一些复杂环境中较弱的情况。

第三,视觉系统ADAS产品测试与评估

目前,还没有统一的ADAS测试和评估标准……

ard。常规测试通常分为两个阶段:

在算法库测试中,库中包含了在各种工况下采集的驾驶场景视频,并利用库中的场景视频测试算法识别率。目前,测试库由每家公司自行测试,因为集合中使用的传感器不同,不同企业的测试结果也不具有可比性。

KITTI由德国卡尔斯鲁厄理工学院和芝加哥丰田理工学院共同创立,是一个国际权威的机动车辅助驾驶应用技术评估算法评估平台。目前,一些公司在这个网站上测试算法,结果是公开的。不同公司的运行时间存在差异,因此我们在查看结果排名时不能忽视多个参数的比较。

在实车测试阶段,将产品DEMO安装在车内进行测试,并根据漏报和误报判断算法的可靠性,对发现的问题进行反复调试。目前,高质量的实车测试大多由主机厂和零部件供应商控制。精确测量需要激光雷达等设备的帮助,在相互验证的过程中完成测量,成本略高,测试周期略长。

据业内人士介绍,算法库测试更多的是用来测试产品70-90分的能力,而实车定量测试必须在90-95分甚至95-98分的差距时进行。目前,ADAS家庭之间的差距在于将分数从90分提高到99分。为了做到这一点,我们必须做大量的实际道路测试,并打磨算法的准确性和稳健性。因此,在某种程度上,在OEM中经历过Tier1严格培训的解决方案提供商具有更高的产品可靠性,预安装经验将成为下一次合作谈判的资本。

目前,企业声称衡量算法能力的“识别率”指标不能说完全没有参考价值。前提是,所谓的识别率应该在不同的复杂场景下进行评估,单独谈论识别率指数是没有意义的,因此需要与其他指标一起考虑。该产品必须确保算法能够在不同的路况、天气、车辆类型、不同姿势的人和不同的车道线下稳定(稳健)工作。

第四,兄弟Mobileye

视听部门ADAS不得不提到一家以色列公司Mobileye,该公司成立于1999年,2007年推出了第一款产品,并于2014年8月1日在纽约证券交易所上市。公司主要从事汽车行业计算机视觉算法和驾驶员辅助系统芯片技术的研究。摄像头是ADAS的核心传感器。与毫米波雷达和激光雷达相比,最大的优势在于识别(物体是汽车还是人,标志牌是什么颜色)。汽车行业对价格敏感,摄像头硬件的成本相对较低。由于近年来计算机视觉的快速发展,从相机角度切入ADAS感知的初创公司数量也非常可观。

这些初创公司可以统称为视觉解决方案提供商。他们掌握核心视觉传感器算法,为下游客户提供包括车载摄像头模块、芯片和软件算法在内的全套解决方案。在预安装模式下,视觉解决方案提供商扮演第二级供应商的角色,与Tier1合作为OEM定义产品。在安装后的模式中,除了提供一套完整的设备外,还有一种出售算法的模式。

本文将分析视觉ADAS的功能、硬件要求和评估标准,并在《[车云报告]ADAS视觉解决方案简介盘点(第二部分)》中参考Mobileye对国内11家初创公司的产品进行详细解读。

视觉ADAS供应链系统

首先,视觉ADAS可以实现功能

由于安全记录和停车的需要,汽车中使用了大量的摄像头作为行车记录仪和倒车影像等辅助功能。一般来说,图像都是收集的……

通过安装在车身各个位置的广角摄像头,经过校准和算法处理,生成或拼接图像形成视图,以补充驾驶员的视觉盲点,而不涉及车辆控制,因此越来越重视视频处理,技术已经成熟并逐步普及。

目前,在驾驶辅助功能中,摄像头可以独立实现许多功能,并根据自动驾驶的发展规律逐步进化。

这些功能更加强调对输入图像的处理,从拍摄的视频流中提取有效的目标运动信息进行进一步分析,给出预警信息或直接调动控制机制。与视频输出功能相比,它强调高速下的实时性能,这部分技术正处于发展的上升期。

第二,视觉ADAS的软硬件要求

视觉系统ADAS产品由软件和硬件组成,主要包括摄像头模块、核心算法芯片和软件算法。在硬件方面,应考虑驾驶环境(振动、高低温等),大前提是满足车辆法规的要求。

(1) 车载ADAS摄像头模块

车载ADAS摄像头模块需要定制化开发。为了满足全天候车辆的需求,当明暗对比度太大(进出隧道)时,通常需要平衡图像中太亮或太暗(宽动态)的部分。对光敏感(高灵敏度),避免给芯片带来太大压力(不要盲目追求高像素)。

摄像头模块是基础。就像一张有着良好基础的照片一样,也有美化的空间。在保证拍摄到的图像足够的基础上,该算法可以更好地发挥作用。

此外,在参数方面,ADAS和行车记录仪对摄像头有不同的要求。用于行车记录仪的摄像头需要看到汽车前部周围尽可能多的环境信息(后视镜看着两个前轮,水平视角约为110度)。ADAS的摄像头更注重为驾驶预留更多的判断时间,需要看得更远。与相机镜头的广角和长焦类似,这两个参数不可能同时存在,ADAS只能在选择硬件时进行平衡。

(2) 核心算法芯片

图像相关算法对计算资源的要求很高,因此芯片的性能也很特殊。如果在算法上叠加深度学习来帮助提高识别率,那么对硬件性能的要求只会增加,主要性能指标是操作速度、功耗和成本。

目前,ADAS相机中使用的芯片大多被外国垄断,主要供应商有瑞萨电子、ST微电子(ST)、自由规模、雅德诺(ASIC)、德州仪器(TI)、恩智浦、富士通、赛灵思、英伟达等。

ARM、DSP、ASIC、MCU和SOC是软件编程的嵌入式方案。与嵌入式系统相比,FPGA具有更快的处理速度,因为它直接对硬件进行编程。

GPU和FPGA具有较强的并行处理能力。对于图片之类的文本,尤其是在使用深度学习算法时,需要多个像素同时计算,FPGA和GPU将具有更多优势。这两种芯片的设计思想相似,都是为了处理大量简单重复的操作而设计的。GPU的性能更强,但能耗更高。由于FPGA的编程和优化是直接在硬件层面进行的,因此能耗会低得多。

因此,FPGA被认为是一种流行的平衡算法和处理速度的方案,尤其是当它用于预安装并且算法稳定时。FPGA是一个不错的选择。但与此同时,FPGA的技术要求也很高。原因是计算机视觉算法是用C语言编写的,FPGA硬件语言是verilog。这两种语言是不同的,所以将算法移植到FPGA的人应该有软件背景和硬件背景。在人才最昂贵的今天,这是一个不小的成本。

目前,可以在传统的计算机视觉算法中使用的车规芯片有很多选择,但低功耗和……

适用于传统算法和深度学习算法的高性能芯片并没有真正出现。

(3) 算法

ADAS视觉算法的来源是计算机视觉。

传统的物体计算机视觉识别大致可以分为几个步骤:图像输入、预处理、特征提取、特征分类、匹配和完全识别。

有两个特殊的地方依赖于专业经验:第一个是特征提取。识别障碍物时有许多可用的功能,功能设计尤其重要。要判断前方的障碍物是否是汽车,参考特征可能是汽车的尾灯,也可能是汽车底盘在地面上投射的阴影。二是预处理和后处理。预处理包括输入图像的噪声平滑、对比度增强和边缘检测。后处理是指对分类和识别结果候选者进行后处理。

科学研究中的计算机视觉算法模型在应用于实际环境时可能表现不佳。由于科学研究获得的算法会增加天气、复杂路况等条件,在现实世界中,除了要注意算法在复杂环境中的性能外,还要考虑算法在各种环境中的鲁棒性(稳定性)。

算法的一个重要变化是深度学习的渗透。

深度学习使计算机能够模拟人类思维的神经网络,并能够自行学习和判断。通过将校准后的原始数据直接输入计算机,例如选择一堆异形汽车的图片,然后将其扔到计算机中,它可以自己学习汽车是什么。这样,可以省去计算视觉特征提取和预处理的步骤,将感知过程简化为输入图片和输出结果两个步骤。

业内一致认为,在感知方面,深度学习将在角落里超越传统的视觉算法。目前,深度学习的算法模型已经开源,算法种类不多,因此有可能降低阈值,并产生大量优秀的结果。然而,由于缺乏合适的汽车平台,距离商业化还有很长的路要走。

业界对深度学习在ADAS中的应用的看法是客观而冷静的。许多人认为深度学习算法是Blackbox算法,类似于人类感知决策的过程,可以快速输出结果,因此很难在事故发生后检查原因。因此,在使用深度学习时应添加理性决策,并将设计划分为多个块。

还有一种观点认为,传统的计算机视觉算法比我们想象的更智能,它也可以在不断寻找车辆图片异同的过程中检测到一些异形车辆。并且在叠加深度学习算法后,传统的计算机视觉算法也可以帮助减少深度学习神经网络的层数,简化算法。

可以肯定的是,无论哪种算法,数据都是训练和测试的宝贵资源,而且不是简单地说越多越好,而是越有效越好(符合实际的汽车环境并确保多样化)。

(4) 不同的摄像机平台

单眼和双目

为了完成ADAS任务,视觉方案通常需要实现两项任务:测距(车辆与前方障碍物之间的距离)和识别(障碍物是什么)。根据汽车摄像头模块的不同,目前主流的ADAS摄像头可以分为单眼和双目两种技术路线。

单眼相机的算法思想是先识别后测距:首先通过图像匹配进行识别,然后根据图像大小和高度进一步估计障碍物和车辆时间。在识别和估计阶段,有必要与已建立的样本数据库进行比较。如果你想识别各种汽车,你需要建立一个车型数据库,如果你想鉴定麋鹿,你需要创建一个麋鹿数据库。

双目摄像机的算法是先测距后识别:首先,通过视差直接测量物体和汽车之间的距离,原理与人眼相似。当两只眼睛看着同一物体时……

t、 会有视差,也就是说,当他们闭上左眼和右眼看物体时,他们会发现感觉位移。这种位移可以进一步测量目标物体的距离。然后,在识别阶段,双目仍然需要使用与单眼相同的特征提取和深度学习算法来进一步识别障碍物。

因为视差越远,视差就越小。业内有观点认为,双目在20米以内具有明显的测距优势,在20米以外很难减少视差测距。我们可以使用高像素相机和更好的算法来提高测距性能,这是难点和核心竞争力。

双目透镜间距和距离测量是两个权衡参数。透镜间距越小,检测距离越近,透镜间距越大,检测距离就越远。考虑到汽车的美观性和ADAS的需求,小型远程双目产品更受欢迎。

由于增加一个镜头会带来更多的计算量,因此整个相机模块的性能要求和成本都更高。此外,在两者的校准工作中,双目比单眼更为复杂。

此外,选择双目方案切入市场并不能完全绕过单眼方案的难度。在第二阶段,您仍然需要一个庞大的数据库并完善算法。

单眼对比

多摄像头方案

除了一台双目望远镜外,还有一个由多台摄像机组成的平台。在一些方案中,选择长焦和广角相机与ADAS主相机配合,兼顾周围环境和远处物体检测。例如,Mobileye方案将在下面介绍。

也有ADAS功能叠加在全景平台上的情况。例如,对于环视进行车道偏离警告(LDW),与单目实现该功能相比,它具有一定的优势。在大雨或前方光源强的情况下,前视摄像头可能看不清车道线,摄像头可以斜向下看车道线并提供多个角度,基本不受地面水反射的影响,其功能可以比前视摄像头更稳定。但同时,我们也要考虑在侧面没有大灯的情况下摄像头的夜间表现。

这些方案与单眼在技术路线上没有本质区别。它们更多地基于不同的平台,充分发挥不同类型相机模块的优势来分配任务,或者提供更多的视角来解决单眼在一些复杂环境中较弱的情况。

第三,视觉系统ADAS产品测试与评估

目前,还没有统一的ADAS测试和评估标准。常规测试通常分为两个阶段:

在算法库测试中,库中包含了在各种工况下采集的驾驶场景视频,并利用库中的场景视频测试算法识别率。目前,测试库由每家公司自行测试,因为集合中使用的传感器不同,不同企业的测试结果也不具有可比性。

KITTI由德国卡尔斯鲁厄理工学院和芝加哥丰田理工学院共同创立,是一个国际权威的机动车辅助驾驶应用技术评估算法评估平台。目前,一些公司在这个网站上测试算法,结果是公开的。不同公司的运行时间存在差异,因此我们在查看结果排名时不能忽视多个参数的比较。

在实车测试阶段,将产品DEMO安装在车内进行测试,并根据漏报和误报判断算法的可靠性,对发现的问题进行反复调试。目前,高质量的实车测试大多由主机厂和零部件供应商控制。精确测量需要激光雷达等设备的帮助,在相互验证的过程中完成测量,成本略高,测试周期略长。

据业内人士介绍,算法库测试更多的是用来测试产品70-90分的能力,而实车quan……

当差值为90-95分或甚至95-98分时,必须进行权威测试。目前,ADAS家庭之间的差距在于将分数从90分提高到99分。为了做到这一点,我们必须做大量的实际道路测试,并打磨算法的准确性和稳健性。因此,在某种程度上,在OEM中经历过Tier1严格培训的解决方案提供商具有更高的产品可靠性,预安装经验将成为下一次合作谈判的资本。

目前,企业声称衡量算法能力的“识别率”指标不能说完全没有参考价值。前提是,所谓的识别率应该在不同的复杂场景下进行评估,单独谈论识别率指数是没有意义的,因此需要与其他指标一起考虑。该产品必须确保算法能够在不同的路况、天气、车辆类型、不同姿势的人和不同的车道线下稳定(稳健)工作。

第四,兄弟Mobileye

视听部门ADAS不得不提到一家以色列公司Mobileye,该公司成立于1999年,2007年推出了第一款产品,并于2014年8月1日在纽约证券交易所上市。公司主要从事汽车行业计算机视觉算法和驾驶员辅助系统芯片技术的研究。Mobileye的产品覆盖全球50个国家。根据官方数据,截至2015年底,Mobileye的全球装载能力为1000万,到2016年底将有273份SOP合同。

(A) 公司定位

在预装配业务中,这家以色列公司作为二级部件供应商向Tier1提供产品,与车辆应用相关的零部件将与OEM合作。通过一线供应商提供集成、个性化开发和测试。安装完成后,采用代理销售的方式。

(2) 产品功能

目前,安装在后视镜后面的单色摄像头(非标准RGB传感器)可以用于检测、识别和分类目标,同时可以跟踪和分析物体的运动轨迹,分析路况。功能包括车道检测、车辆检测、行人检测、动物检测、交通标志识别、红绿灯识别和灯光控制。

Mobileye拥有自主研发和设计的芯片EyeQ系列,由STM微电子公司生产和供应。目前已经大规模生产的芯片型号包括EyeQ1、EyeQ2和EyeQ3。EyeQ4正在开发中,预计将于2018年推出,其工程样品预计将于2016年第四季度发布。2016年5月,Mobileye宣布将与STF合作开发用于自动驾驶的下一代EyeQ5芯片,并于2018年开始提供工程样品。

目前,Mobileye的后装产品终端价格在8000元左右,前装价格会低很多。

Mobileye的不同芯片可以实现不同的ADAS功能。其中,EYEQ2支持产品级AEB,EyeQ3支持完整的AEB。EyeQ2只能实现ASIL-B,而EyeQ3可以实现ASIL-D。。(ASIL,汽车安全集成级别,是ISO26262中系统危险风险级别的指标,产品的安全级别从A依次增加到D。)

Mobileye EyeQ1-EyeQ3产品地图

2007年,沃尔沃实现了摄像头+雷达一体化防撞预警功能。(眼睛Q1)

2008年,宝马实现了单摄像头车道偏离预警和交通标志识别。(眼睛Q1)

2010年,沃尔沃实现了行人碰撞检测,AEB是第一个行人检测。(眼睛Q2)

在宝马、通用和欧宝上,一个摄像头被用来跟踪拥堵车道上的汽车。(眼睛Q2)

2013年,宝马和日产使用了摄像头来实现AEB功能(部分)。(眼睛Q2)

宝马大规模生产的基于摄像头的自适应巡航(ACC)和交通堵塞助手(Traffic Jam Assistant)是通过使用EYEQ2实现的。(眼睛Q2)

2015年,奥迪实现了基于摄像头的全AEB功能。(眼睛Q3)

在特斯拉模型上实现交通检测,并通过深度神经网络判断自由空间和路径规划。(眼睛Q3)

在Mobileye过去的演讲和介绍中,提到了前车识别算法的一些细节:

从车辆识别的角度来看,单目识别通常有两种算法……

预测,一个是THW(Time Headway),另一个是TTC(Time to Collision)。在THW计算公式中,时间t=两辆车之间的距离/车辆的速度;在TTC公式中,时间t'=车辆距离/两辆车的相对速度。TTC对计算有更高的要求,因为除了车辆的速度外,还应该实时测量前一辆车的速度。计算方法是估计两辆车之间的距离和它们自身的速度。

Mobileye在不同的场景中使用了两种算法。

TTC用于前方碰撞检测(FCW),尤其是在高速行驶时在汽车前方突然制动的情况下。可以清楚地发现,TTC的算法更符合实际情况。Mobileye检测规划路径前后的车辆(不仅仅是识别该车道上的车辆),并利用图像的变化速度进行TTC,从而判断碰撞的可能性,并采取干预、控制和制动控制。

目前,Mobileye售后产品的TTC时间设定为2.7秒,官方FCW准确度约为99.99%。对于前装,TTC是为该车道上离车辆最近的车辆计算的,AEB通常在1秒的间隔内工作。

Mobileye采用THW算法,在未来的控制下,它可以使用单个摄像头作为ACC或低速交通堵塞助手。目前,这两项功能都是由市场上的毫米波雷达实现的。如果使用摄像头,它可以集成视觉检测到的车道、静态障碍物、车辆的横向运动和限速标志,并汇总多个信息来做出ACC决策,控制将更加准确。

Mobileye售后市场产品的THW时间设置可以从2.5秒到0.1秒。

(3) 自动驾驶规划

关于如何实现自动驾驶,Mobileye将涉及感知、地图和驾驶策略三个方面。

在感知方面,根据Mobileye的计划,在不考虑冗余的情况下,需要8个摄像头来满足360度全方位感知的需求。2015年,Mobileye发布了三款摄像头来实现ADAS功能。这三个摄像头有不同的分工:中间的主摄像头可以实现大多数功能,检测距离可以达到150米,检测后跟踪距离可以达到250米。另一个小角度相机可以检测更长的距离,而广角镜头可以检测更宽的视野。

该算法主要实现四个内容,对深度学习的要求逐项增加:

1.识别道路上的移动/固定物体;

2.识别道路分界线和其他交通标志;

3.当道路上没有分界线或分界线不清晰时,区分哪些空间可以通过,并划出通过空间与其他部分的分隔线;

4.可行驶路径:确定可通行空间后,找到行驶路线。

地图是感知系统的冗余设计,包括路标、高精度定位和可行驶路径三个方面。Mobileye打算通过具有深度学习功能的图像识别系统制作高精度地图。数据采集将与汽车公司合作,通过众包方式获取和更新数据。

在驾驶策略方面,车企可以通过提供的SDK访问Mobileye预先训练的网络应用层,使控制单元能够快速计算并获得可行的路径方案。他们将在车企提供的算法基础上,结合自己在车辆控制方面的经验进行优化或重新开发。该功能将在Eye的基础上实现。

Mobileye计划在2016年推出半自动汽车技术。即将开发的系统可以让汽车读取各种交通和街道信号,从而与其他车辆保持适当的距离。大众、宝马和通用汽车购买了2018年生产的系统,该系统使车辆能够高速自动驾驶。2016年5月,Mobileye和两家保密汽车公司达成协议,将在2019年为后者提供全自动驾驶汽车系统。

2016年7月,Mobileye与宝马、英特尔共同开发无人驾驶汽车技术。2016年8月,宣布将与德尔福汽车公司共同开发一套完整的SAE(美国汽车工程协会)4/5自动驾驶解决方案。

(四) 团队简介

创始人之一是耶路撒冷希伯来大学的计算机科学教授Amnon Shashua。Mobileye在美国、德国、日本和西班牙也有分支机构或研究部门。现在,公司有600多名员工,研发人员占70%-80%。目前,中国只有一个售后团队,办公室位于上海,没有研发人员。

(五) 投资和融资

2006年5月,它获得了1500美元的投资。

2007年10月,高盛投资了1亿美元。

2013年7月,Mobileye向五家独立金融投资者出售了4亿股股票。投资者包括黑石集团(Blackstone)、富达集团(Fidelity)、威灵顿集团(Wellinton)、恩特汽车租赁公司(Ente Car Rental Company)和中国投资公司帆船国际投资基金(China Investment Company Sailing International Investment Fund)。除现金外,这笔交易对Mobileye的估值为15亿美元。

相关阅读:

ADAS视觉解决方案盘点第二部分:对11家初创公司的完整解读Mobileye的产品覆盖全球50个国家。根据官方数据,截至2015年底,Mobileye的全球装载能力为1000万,到2016年底将有273份SOP合同。

(A) 公司定位

在预装配业务中,这家以色列公司作为二级部件供应商向Tier1提供产品,与车辆应用相关的零部件将与OEM合作。通过一线供应商提供集成、个性化开发和测试。安装完成后,采用代理销售的方式。

(2) 产品功能

目前,安装在后视镜后面的单色摄像头(非标准RGB传感器)可以用于检测、识别和分类目标,同时可以跟踪和分析物体的运动轨迹,分析路况。功能包括车道检测、车辆检测、行人检测、动物检测、交通标志识别、红绿灯识别和灯光控制。

Mobileye拥有自主研发和设计的芯片EyeQ系列,由STM微电子公司生产和供应。目前已经大规模生产的芯片型号包括EyeQ1、EyeQ2和EyeQ3。EyeQ4正在开发中,预计将于2018年推出,其工程样品预计将于2016年第四季度发布。2016年5月,Mobileye宣布将与STF合作开发用于自动驾驶的下一代EyeQ5芯片,并于2018年开始提供工程样品。

目前,Mobileye的后装产品终端价格在8000元左右,前装价格会低很多。

Mobileye的不同芯片可以实现不同的ADAS功能。其中,EYEQ2支持产品级AEB,EyeQ3支持完整的AEB。EyeQ2只能实现ASIL-B,而EyeQ3可以实现ASIL-D。。(ASIL,汽车安全集成级别,是ISO26262中系统危险风险级别的指标,产品的安全级别从A依次增加到D。)

Mobileye EyeQ1 Ey……

3产品地图

2007年,沃尔沃实现了摄像头+雷达一体化防撞预警功能。(眼睛Q1)

2008年,宝马实现了单摄像头车道偏离预警和交通标志识别。(眼睛Q1)

2010年,沃尔沃实现了行人碰撞检测,AEB是第一个行人检测。(眼睛Q2)

在宝马、通用和欧宝上,一个摄像头被用来跟踪拥堵车道上的汽车。(眼睛Q2)

2013年,宝马和日产使用了摄像头来实现AEB功能(部分)。(眼睛Q2)

宝马大规模生产的基于摄像头的自适应巡航(ACC)和交通堵塞助手(Traffic Jam Assistant)是通过使用EYEQ2实现的。(眼睛Q2)

2015年,奥迪实现了基于摄像头的全AEB功能。(眼睛Q3)

在特斯拉模型上实现交通检测,并通过深度神经网络判断自由空间和路径规划。(眼睛Q3)

在Mobileye过去的演讲和介绍中,提到了前车识别算法的一些细节:

从车辆识别的角度来看,单目预测通常有两种算法,一种是THW(Time Headway),另一种是TTC(Time to Collision)。在THW计算公式中,时间t=两辆车之间的距离/车辆的速度;在TTC公式中,时间t'=车辆距离/两辆车的相对速度。TTC对计算有更高的要求,因为除了车辆的速度外,还应该实时测量前一辆车的速度。计算方法是估计两辆车之间的距离和它们自身的速度。

Mobileye在不同的场景中使用了两种算法。

TTC用于前方碰撞检测(FCW),尤其是在高速行驶时在汽车前方突然制动的情况下。可以清楚地发现,TTC的算法更符合实际情况。Mobileye检测规划路径前后的车辆(不仅仅是识别该车道上的车辆),并利用图像的变化速度进行TTC,从而判断碰撞的可能性,并采取干预、控制和制动控制。

目前,Mobileye售后产品的TTC时间设定为2.7秒,官方FCW准确度约为99.99%。对于前装,TTC是为该车道上离车辆最近的车辆计算的,AEB通常在1秒的间隔内工作。

Mobileye采用THW算法,在未来的控制下,它可以使用单个摄像头作为ACC或低速交通堵塞助手。目前,这两项功能都是由市场上的毫米波雷达实现的。如果使用摄像头,它可以集成视觉检测到的车道、静态障碍物、车辆的横向运动和限速标志,并汇总多个信息来做出ACC决策,控制将更加准确。

Mobileye售后市场产品的THW时间设置可以从2.5秒到0.1秒。

(3) 自动驾驶规划

关于如何实现自动驾驶,Mobileye将涉及感知、地图和驾驶策略三个方面。

在感知方面,根据Mobileye的计划,在不考虑冗余的情况下,需要8个摄像头来满足360度全方位感知的需求。2015年,Mobileye发布了三款摄像头来实现ADAS功能。这三个摄像头有不同的分工:中间的主摄像头可以实现大多数功能,检测距离可以达到150米,检测后跟踪距离可以达到250米。另一个小角度相机可以检测更长的距离,而广角镜头可以检测更宽的视野。

该算法主要实现四个内容,对深度学习的要求逐项增加:

1.识别道路上的移动/固定物体;

2.识别道路分界线和其他交通标志;

3.当道路上没有分界线或分界线不清晰时,区分哪些空间可以通过,并划出通过空间与其他部分的分隔线;

4.可行驶路径:确定可通行空间后,找到行驶路线。

地图是感知系统的冗余设计,包括路标、高精度定位和可行驶路径三个方面。Mobileye打算通过具有深度学习功能的图像识别系统制作高精度地图。数据采集将与汽车公司合作,通过众包方式获取和更新数据。

在驾驶策略方面,车企可以通过提供的SDK访问Mobileye预先训练的网络应用层,使控制单元能够快速计算并获得可行的路径方案。他们将在车企提供的算法基础上,结合自己在车辆控制方面的经验进行优化或重新开发。该功能将在Eye的基础上实现。

Mobileye计划在2016年推出半自动汽车技术。即将开发的系统可以让汽车读取各种交通和街道信号,从而与其他车辆保持适当的距离。大众、宝马和通用汽车购买了2018年生产的系统,该系统使车辆能够高速自动驾驶。2016年5月,Mobileye和两家保密汽车公司达成协议,将在2019年为后者提供全自动驾驶汽车系统。

2016年7月,Mobileye与宝马、英特尔共同开发无人驾驶汽车技术。2016年8月,宣布将与德尔福汽车公司共同开发一套完整的SAE(美国汽车工程协会)4/5自动驾驶解决方案。

(四) 团队简介

创始人之一是耶路撒冷希伯来大学的计算机科学教授Amnon Shashua。Mobileye在美国、德国、日本和西班牙也有分支机构或研究部门。现在,公司有600多名员工,研发人员占70%-80%。目前,中国只有一个售后团队,办公室位于上海,没有研发人员。

(五) 投资和融资

2006年5月,它获得了1500美元的投资。

2007年10月,高盛投资了1亿美元。

2013年7月,Mobileye向五家独立金融投资者出售了4亿股股票。投资者包括黑石集团(Blackstone)、富达集团(Fidelity)、威灵顿集团(Wellinton)、恩特汽车租赁公司(Ente Car Rental Company)和中国投资公司帆船国际投资基金(China Investment Company Sailing International Investment Fund)。除现金外,这笔交易对Mobileye的估值为15亿美元。

相关阅读:

ADAS视觉解决方案盘点第二部分:11家初创公司的完整解读

第一电动研究院行业报告与数据由第一电动研究院出品,每月更新发布。

1900/1/1 0:00:00在上篇中,我们盘点了视觉ADAS可以实现的功能、软硬件需求、以及测试评价方法。一哥Mobileye受人尊敬,也是不少国内创业公司争相赶超的对象。

1900/1/1 0:00:00Si负极材料是目前唯一实现商业化应用的新型负极材料,纯硅负极材料在完全充电的状态下比容量可以达到4200mAhg,远高于传统的石墨负极材料。

1900/1/1 0:00:00在北京持续限购、限行的大政策背景下,传统燃油车的号牌成极度稀缺资源。而随着北京市对新能源汽车的不摇号、不限行等政策优待,新能源汽车的号牌资源也正在走向稀缺。

1900/1/1 0:00:002016年10月23日,囊括江淮汽车建设的年产10万台新能源汽车项目在内,合肥经开区19个重大项目集中开工仪式在合肥空港经济示范区举行。

1900/1/1 0:00:00Note7手机的频频爆炸事件,让全世界人民都对三星电池的安全性心有余悸,甚至相关手机机型都被各国禁止使用。在中国汽车圈,正准备大展拳脚的三星电池,如今的日子也并不好过。

1900/1/1 0:00:00