关于无人车的定位有两种,一种称为绝对定位,它直接给出无人车与地球或WGS84坐标系的相对坐标,即坐标(B,L,H),其中B是纬度,L是经度,H是地球与WGS-84椭球体的高度。WGS-84坐标系是由美国国防部开发和确定的大地坐标系,是一个商定的陆地坐标系。WGS-84坐标系定义为:原点为地球质心,空间直角坐标系的Z轴指向BIH(1984.0)定义的极点(CTP)的方向,即常规国际原点的CIO,由IAU和IUGG共同推荐。x轴指向由BIH定义的零子午线平面与CTP赤道的交点,y轴与z轴和x轴形成右手坐标系。WGS-84椭球体采用国际大地测量与地球物理联合会第十七届大会测量常数推荐值,并采用两个常用的基本几何参数:主半轴A=6378137m;

展平比f=1:298.19989.999999999895坐标系非常复杂,GPS测量结果与中国54系列或80系列坐标的差异在几十米到100多米之间,而且不同地区的差异也不同。据粗略统计,西部与东北部的差距约为70米,140米,南部75米,在中间45米。在中国,为了安全起见,当地图发布时,国家对坐标84进行了非线性偏移,得到的坐标称为GCJ02坐标系。国内许多地图公司,可能是由于业务需求或商业竞争的某些原因,在GCJ02坐标的基础上又进行了一次非线性偏置,并建立了自己的坐标系。百度就是这样一家公司。在GCJ02的基础上,百度进行了BD-09二次非线性偏置,得到了自己的百度坐标系。传统的GPS定位精度只有3-7米,中国城市主干道的单车道宽度一般为3.75米,这意味着GPS无法实现车道线定位。在城市道路或峡谷中,精度将进一步降低。即使在美国和北约国家,民用系统也不可能使用GPS进行亚米定位。GPS卫星广播的信号包括载波、测距码和数据码三个信号分量。测距码分为P码(精细码)和C/A码。通常,C/A代码称为民代码,P代码称为军代码。P码将被细分为普通码和W码,完全不可能破解。后来,在新一代GPS上,美国提出了一种特殊的M(军用)码,其细节仍然高度保密,只知道速度为5.115MHz,码长未知。目前北斗的定位精度不如全球定位系统。无人车车道线级别的绝对定位是一个难题,无人车需要更精确的厘米级定位。为了解决这个问题,日本开发了准天顶卫星系统(QZSS),该系统于2010年发射了一颗卫星,并于2017年又发射了三颗卫星,形成了三颗人造卫星的卫星增强系统,通过时间转移完成全球定位系统的区域功能。它将于今年4月1日正式商业化。通过GPS系统,QZSS可以实现6厘米的定位。QZSS系统中L5信号的频点也为1176.45MHz,在该频点采用的码率与GPS相同,均为10.23MHz。这意味着芯片制造商只需改变软件处理即可实现与Galileo和QZSS的兼容性,而无需改变支持GPS系统的原芯片上的硬件,这相当于在软件实现中搜索更多的导航卫星。这几乎不会增加成本,而且北斗系统需要更换硬件,这非常麻烦。由于日本国土面积小,四颗卫星就足够了。如果使用中国或美国,可能需要35-40颗卫星。国内大多数制造商使用GPS RTK进行绝对定位,但RTK的缺点也很明显。RTK在确定整周模糊度方面的可靠性为95~99%,在稳定性方面不如全站仪,因为RTK容易受到卫星条件、天气条件和数据链路传输条件的影响。首先,每天(在中国通常是下午)中、低纬度地区总有两个GPS盲点,每次持续20~30分钟。卫星几何结构在盲点处的强度较低,因此RTK测量很难得到固定的解。其次,在白天的中午,由于电离层干扰,共享卫星的数量较少,因此初始化甚至初始化需要很长时间,无法测量。根据实践经验,RTK测量每天12:00至13:00很难得到固定的解。第三,依靠GPS信号,它不能在隧道和高层地区使用。阿波罗的先进定位技术无人车方案不能完全基于RTK。百度Apollo系统采用激光雷达、RTK和IMU融合的方案,多个传感器的融合和误差状态卡尔曼滤波器使定位精度达到5-10厘米,具有高可靠性和鲁棒性,达到世界顶级水平。城市地区的最高允许速度超过每小时60公里。

ta“src=”/eimg/jndp/ig/20230304013732503791/1.jpg“/>

上图为百度Apollo自动驾驶传感器、计算单元和控制前的连接图。该计算系统使用省Neousys Nuvo-6108GC工业计算机,该计算机使用英特尔双核E5-2658 V3 12核CPU。它主要用于处理激光雷达云点和图像数据。在GPS定位和惯性测量单元方面,IMU为NovAtel IMU-IGM-A1,GPS接收器为NovAtelProPak6。激光雷达采用Velodyne HDL-64S3,通过以太网与工业计算机相连。水平视场为360,垂直视场为26.9,水平角分辨率为0.08,距离精度小于2厘米。它可以探测1.2亿辆汽车或树木。视觉系统使用Leopard Imaging Li USB 30-Ar023 ZWDR,带3.0外壳,通过USB连接到工业计算机。使用Anson的200万像素1080p传感器AR0230AT和AP0202 ISP。视场宽度为58度,有效距离约为60-70米。毫米波雷达采用大陆ARS408-21,与CAN卡相连。CAN卡为德国ESD CAN PCIe/402-B4。

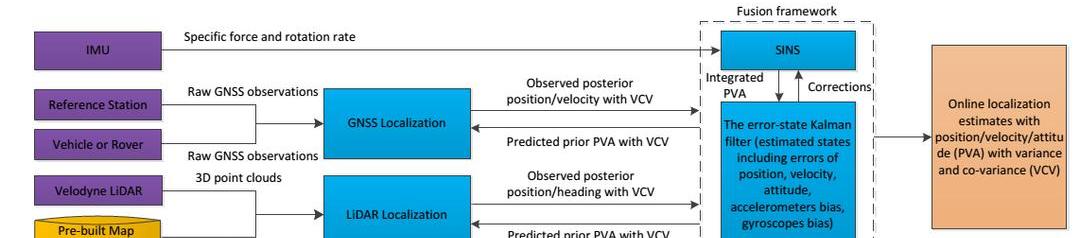

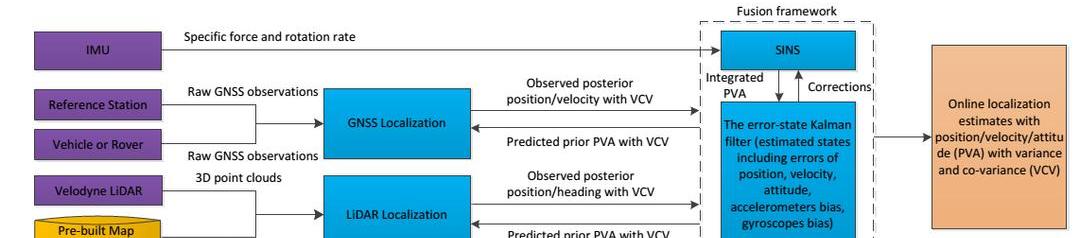

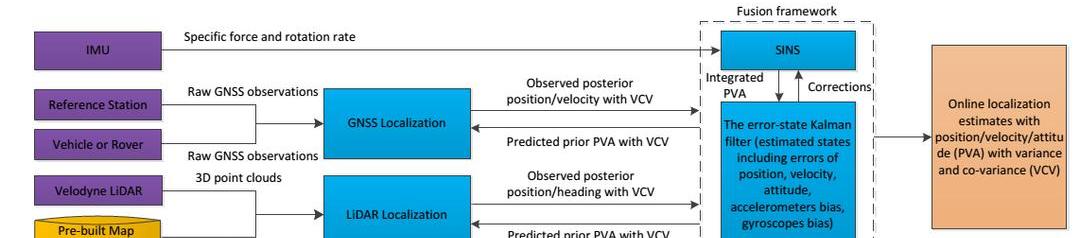

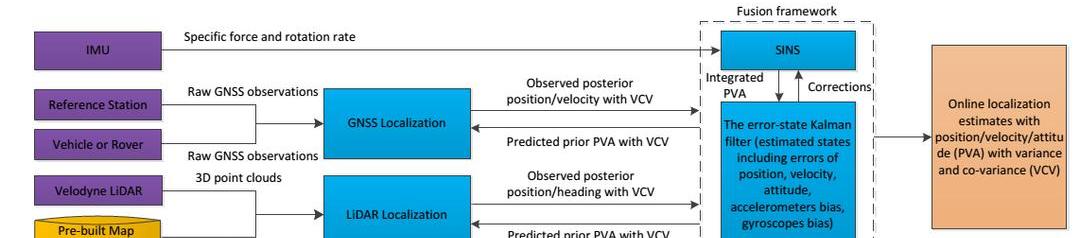

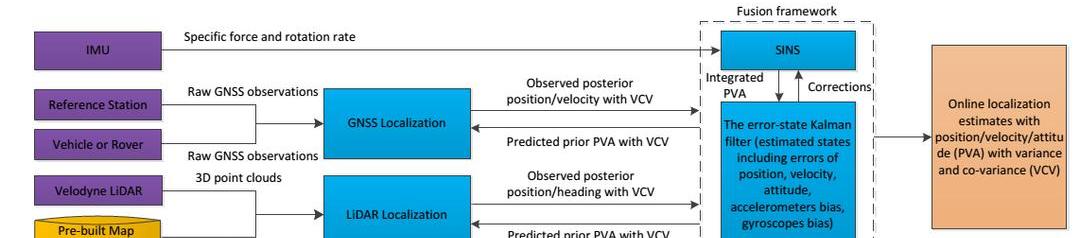

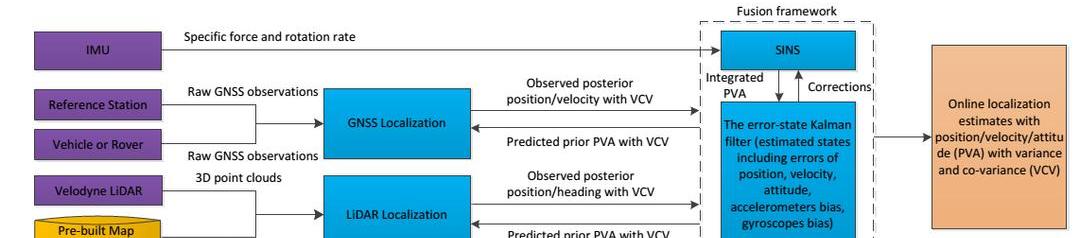

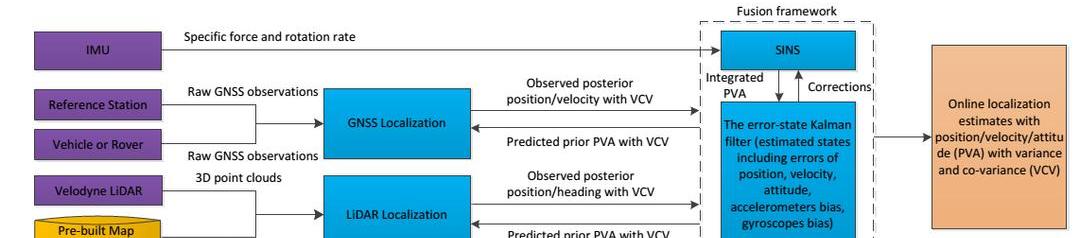

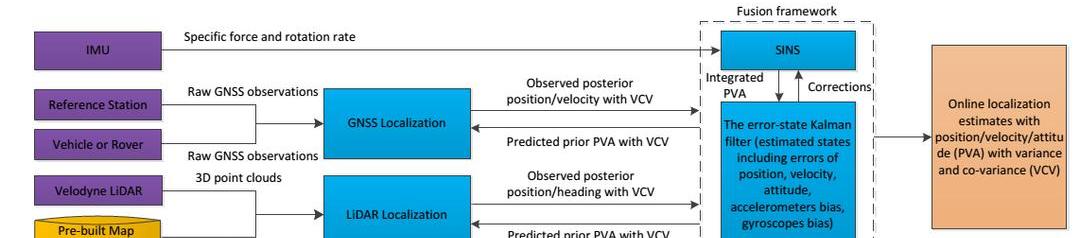

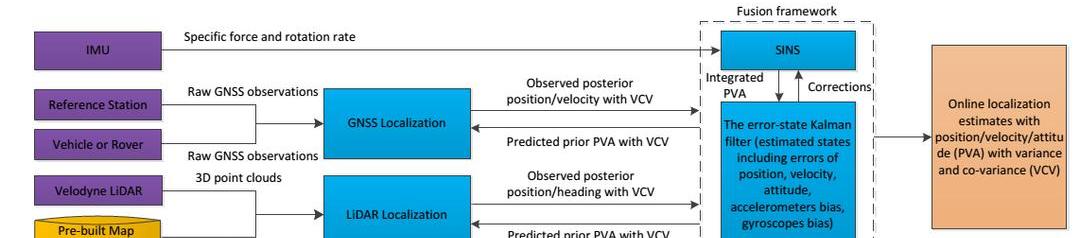

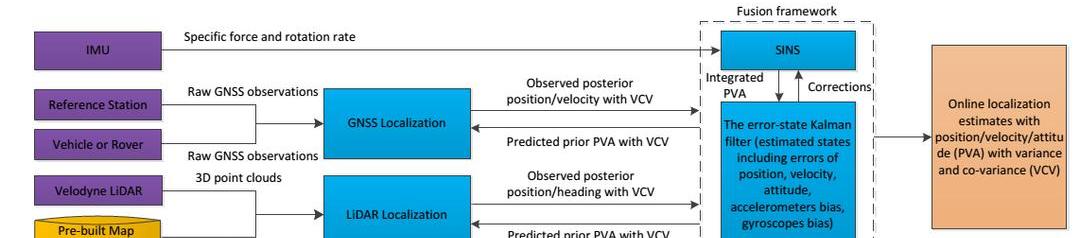

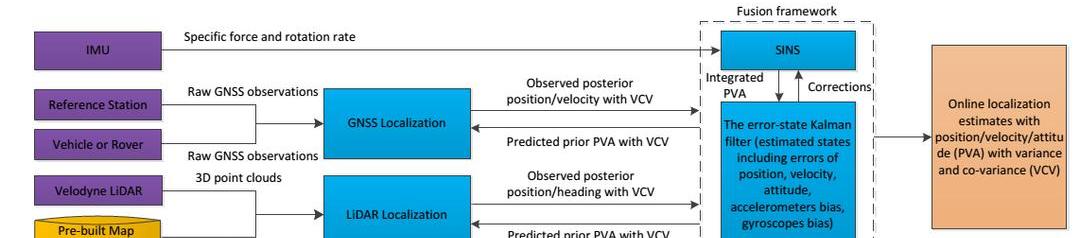

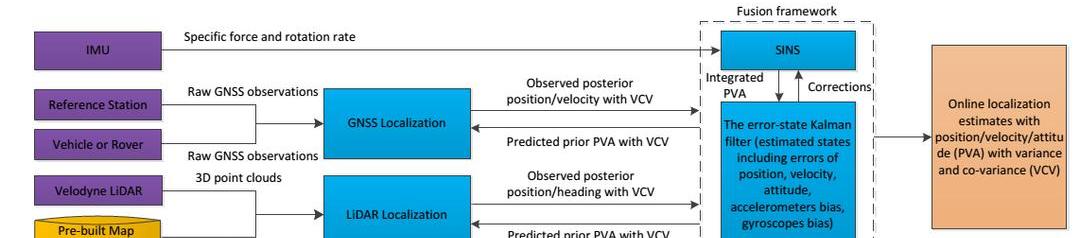

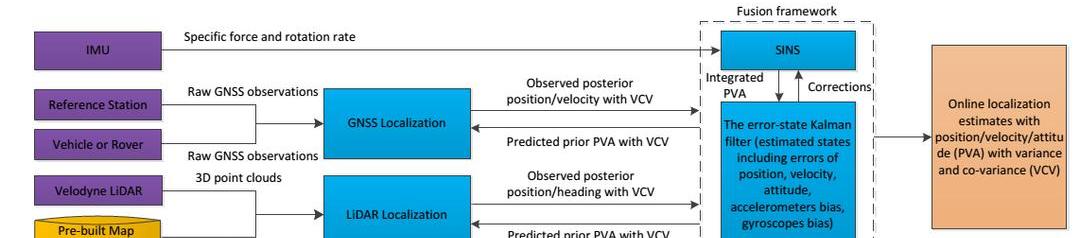

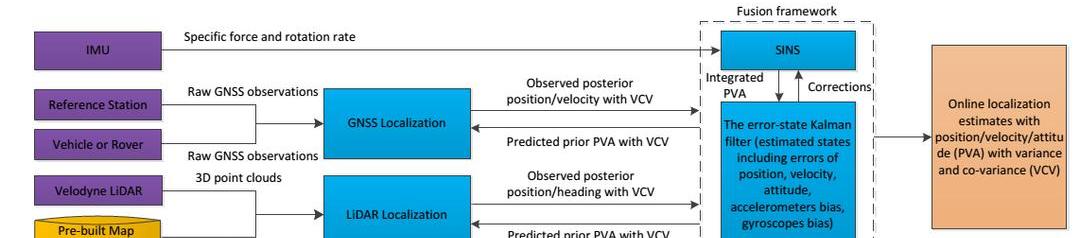

上图显示了百度无人车定位模块的框架,该模块结合了IMU、GNSS和激光雷达等传感器(紫色)和预先制作的定位图(黄色)。最顶层是SINS系统,即捷联惯性导航系统。捷联惯性导航系统是在平台惯性导航系统的基础上发展起来的。它是一个无框架系统,由三个速率陀螺仪、三个线性加速度计和一个处理器组成。SINS对IMU测量的加速度和角速度进行积分,得到位置、速度和姿态,作为卡尔曼滤波器传播阶段的预测模型。因此,卡尔曼滤波器将校正IMU的加速度和角速度,并且位置、速度和姿态等误差也将反馈给SINS。RTK定位和激光雷达点云定位的结果被用作卡尔曼滤波器的测量更新。

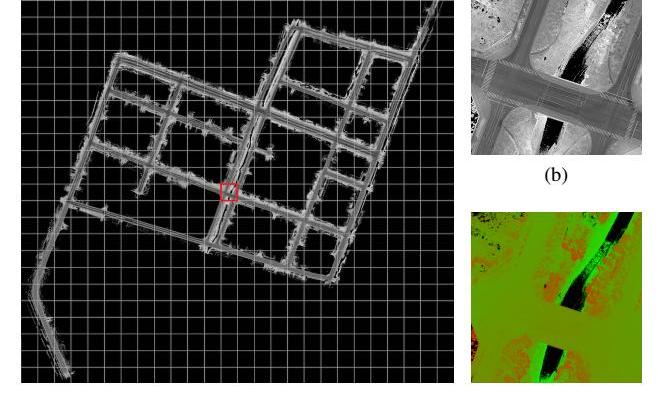

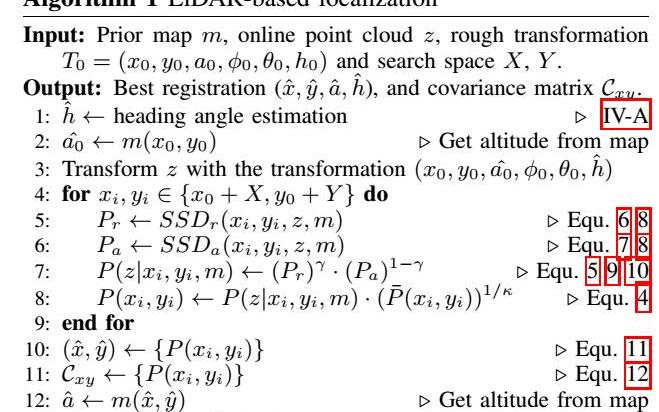

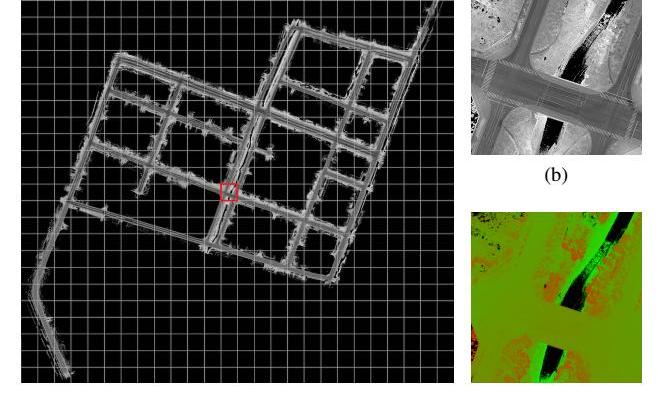

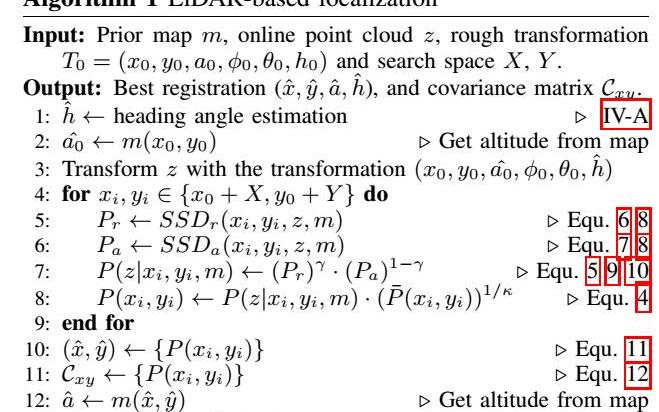

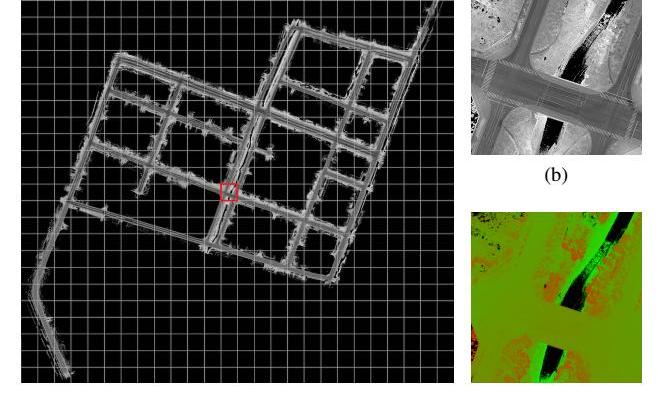

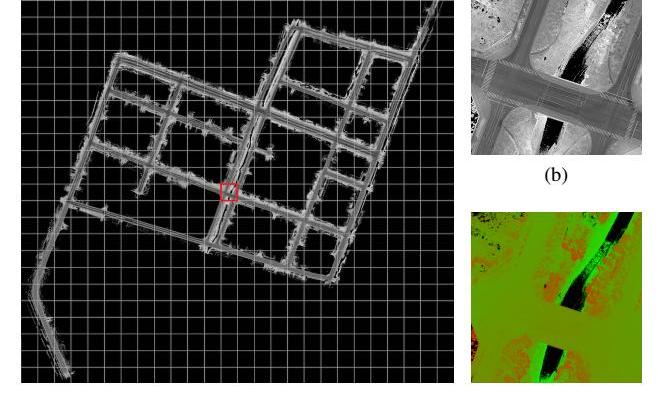

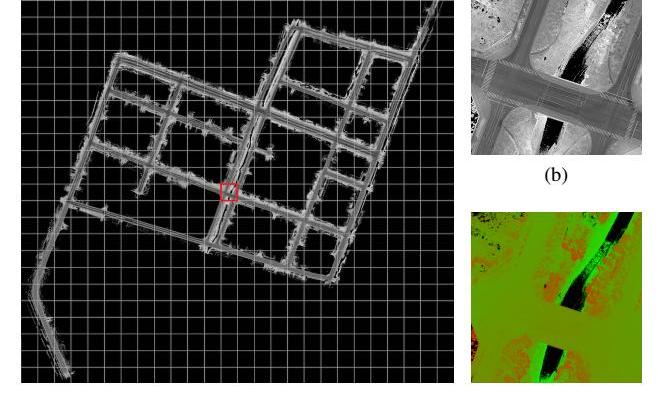

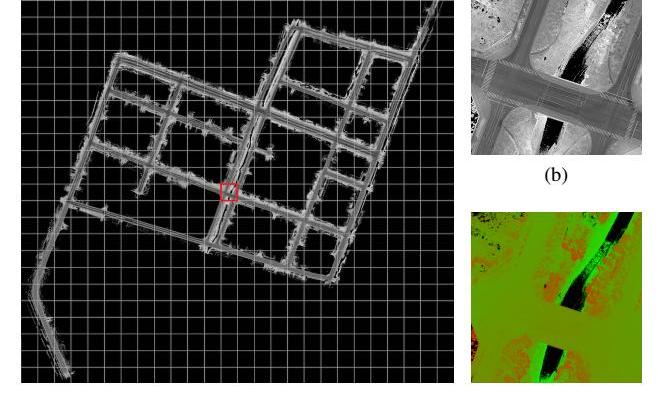

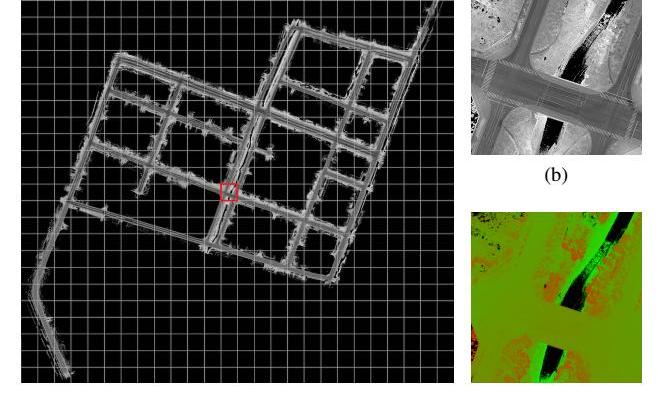

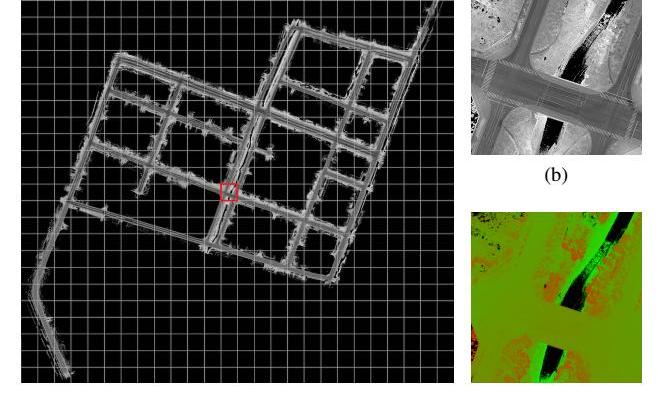

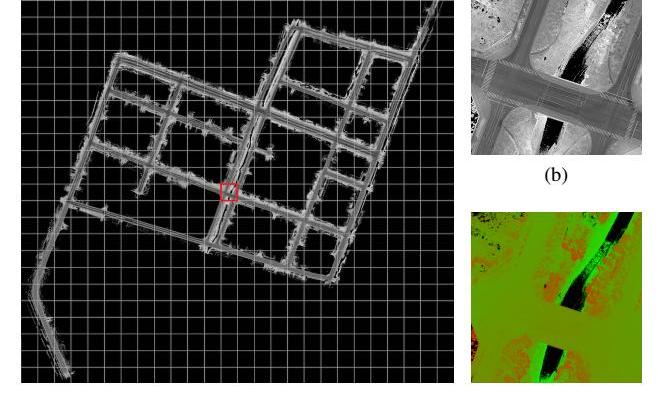

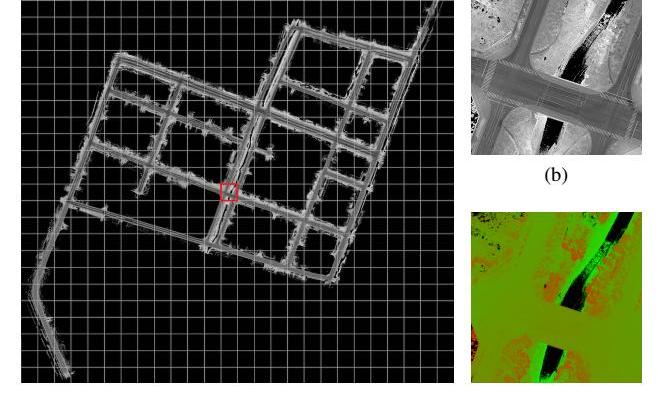

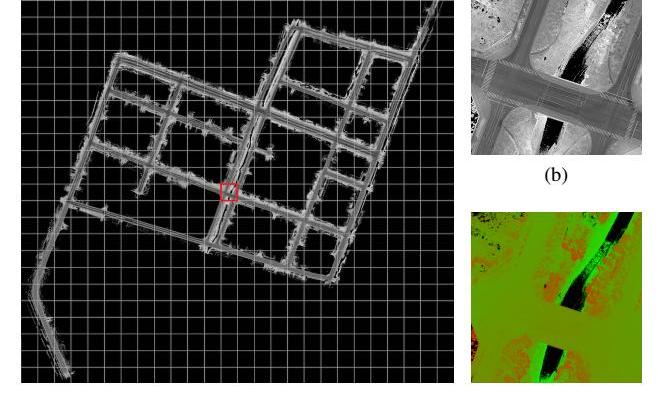

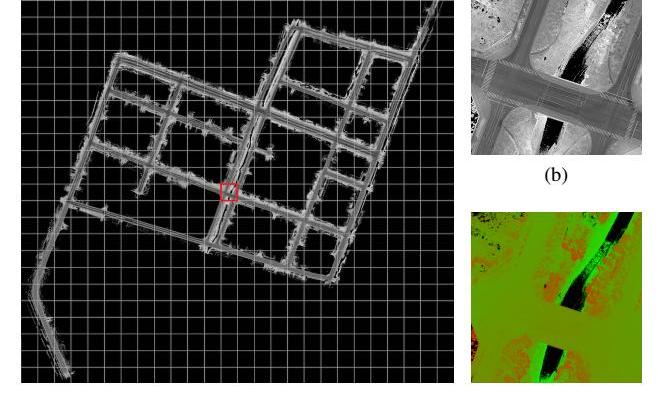

上图为百度的激光雷达点云定位图。首先,要提前制作无人车行驶区域的激光雷达点云定位图,包括激光雷达的强度成像图和高度分布图。该地图通常由地图制造商使用测绘级激光雷达完成。目前,世界上绝大多数制造商,包括Waymo、Ford、GM等。B是激光雷达反射强度的成像图,C是高度分布图。这张地图的面积为3.3*3.1平方公里。激光点云定位算法描述如下:

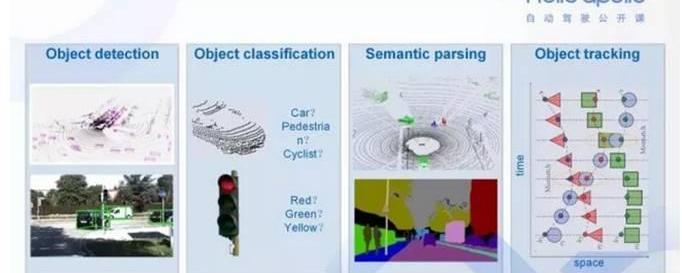

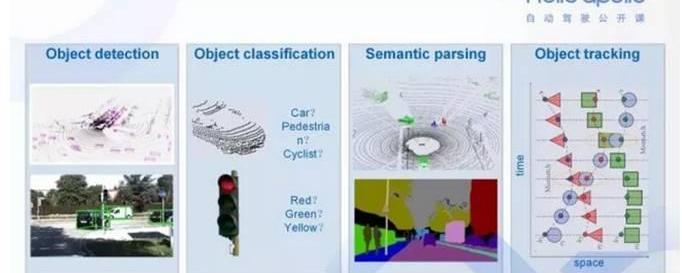

从表面上看,高精度定位非常复杂。在实际计算中,消耗的计算资源并不多,基于激光雷达的计算量远低于基于图像的计算量。未来,该系统也可以用传统的汽车SoC来完成,如瑞萨的R-Car H3、恩智浦的I.MX8或S32A258C。预计成本将大大降低。64线激光雷达也有望在未来被闪光固态激光雷达所取代,从而大大降低成本。百度无人车定位团队的一篇学术论文《基于多传感器融合的多样化城市场景下稳健精确的车辆定位》已被顶级机器人大会ICRA 2018聘用,初稿可从arXiv下载。Apollo的感知技术Apollo中的感知模块具有以下功能:检测目标(是否有障碍物)、对目标进行分类(障碍物是什么)、语义分割(对整个帧中的障碍物进行分类和渲染)以及目标跟踪(障碍物跟踪)。

Apollo 2.0系统利用多传感器融合做环境感知,摄像头负责红绿灯的检测,毫米波雷达最大的作用是提供目标的移动速度,目标识别主要由激光雷达完成。2016年10月,百度和清华联合发表了一篇题为《自动驾驶多视图三维物体检测网络》的论文,位于https://arxiv.org/pdf/1611.07759.pdf.本文使用激光雷达和相机的融合来……

确定目标。然而,在百度2017年5月发表的一篇论文《使用生产网络的3D激光雷达车辆检测》中,https://arxiv.org/pdf/1608.07916.pdf,放弃了与摄像头的集成。2017年10月,增加了毫米波雷达融合。2017年11月,苹果公司发表了一篇论文《体素网:仅使用激光雷达识别目标的基于点云的三维物体检测的端到端学习》,并将其与百度和清华多视图自动驾驶三维物体检测网络进行了比较,表明单用激光雷达的效果更好。原因是激光雷达的数据处理速度比相机快,时间同步非常困难,两者的坐标需要统一;其次,相机对光线太敏感,可靠性低,尤其是在长距离拍摄时。在Apollo 2.0中,百度使用了激光雷达和毫米波雷达的融合方案。

激光雷达物体识别的最大优点是,无论白天还是晚上,无论是林荫大道还是光线急剧变化的隧道出口,都可以完全消除光线的干扰。其次,激光雷达可以很容易地获得深度信息,这对摄像系统来说是非常困难的。再次,激光雷达的有效距离远高于摄像头,进一步的有效距离等于增加了安全冗余。最后,在进行深度学习目标识别时,激光雷达的3D云点和相机的2D图像容易出现透视失真。简单地说,透视变形是指一个物体及其周围区域与标准镜头中看到的完全不同,并且由于远近特征的相对比例的变化而弯曲或变形。这是透镜的固有特性(凸透镜聚光,凹透镜发散),因此无法消除,只能改进。这个问题在3D中不存在,因此用于3D图像深度学习的神经网络可以更简单。此外,激光雷达还可以识别颜色和车道线。无人车领域目标图像的识别不仅仅是识别,还包括分割和跟踪。分割是用一个对象框住目标。对于2D图像,只能使用2D帧来分割目标,而激光雷达图像可以是3D帧,这更安全。跟踪是预测车辆或行人可能的轨迹。

显然,3D分割帧比2D分割帧更有价值,这也是Waymo和百度都使用激光雷达识别车辆的原因之一。DPM早期被用于目标检测和识别领域。关于无人车的定位有两种,一种称为绝对定位,它直接给出无人车与地球或WGS84坐标系的相对坐标,即坐标(B,L,H),其中B是纬度,L是经度,H是地球与WGS-84椭球体的高度。WGS-84坐标系是由美国国防部开发和确定的大地坐标系,是一个商定的陆地坐标系。WGS-84坐标系定义为:原点为地球质心,空间直角坐标系的Z轴指向BIH(1984.0)定义的极点(CTP)的方向,即常规国际原点的CIO,由IAU和IUGG共同推荐。x轴指向由BIH定义的零子午线平面与CTP赤道的交点,y轴与z轴和x轴形成右手坐标系。WGS-84椭球体采用国际大地测量与地球物理联合会第十七届大会测量常数推荐值,并采用两个常用的基本几何参数:主半轴A=6378137m;

展平比f=1:298.19989.999999999895坐标系非常复杂,GPS测量结果与中国54系列或80系列坐标的差异在几十米到100多米之间,而且不同地区的差异也不同。据粗略统计,西部与东北部的差距约为70米,140米,南部75米,在中间45米。在中国,为了安全起见,当地图发布时,国家对坐标84进行了非线性偏移,得到的坐标称为GCJ02坐标系。国内许多地图公司,可能是由于业务需求或商业竞争的某些原因,在GCJ02坐标的基础上又进行了一次非线性偏置,并建立了自己的坐标系。百度就是这样一家公司。在GCJ02的基础上,百度进行了BD-09二次非线性偏置,得到了自己的百度坐标系。传统的GPS定位精度只有3-7米,中国城市主干道的单车道宽度一般为3.75米,这意味着GPS无法实现车道线定位。在城市道路或峡谷中,精度将进一步降低。即使在美国和北约国家,民用系统也不可能使用GPS进行亚米定位。GPS卫星广播的信号包括载波、测距码和数据码三个信号分量。测距码分为P码(精细码)和C/A码。通常,C/A代码称为民代码,P代码称为军代码。P码将被细分为普通码和W码,完全不可能破解。后来,在新一代GPS上,美国提出了一种特殊的M(军用)码,其细节仍然高度保密,只知道速度为5.115MHz,码长未知。目前北斗的定位精度不如全球定位系统。无人车车道线级别的绝对定位是一个难题,无人车需要更精确的厘米级定位。为了解决这个问题,日本开发了准天顶卫星系统(QZSS),该系统于2010年发射了一颗卫星,并于2017年又发射了三颗卫星,形成了三颗人造卫星的卫星增强系统,通过时间转移完成全球定位系统的区域功能。它将于今年4月1日正式商业化。通过GPS系统,QZSS可以实现6厘米的定位。QZSS系统中L5信号的频点也为1176.45MHz,在该频点采用的码率与GPS相同,均为10.23MHz。这意味着芯片制造商只需改变软件处理即可实现与Galileo和QZSS的兼容性,而无需改变支持GPS系统的原芯片上的硬件,这相当于在软件实现中搜索更多的导航卫星。这几乎不会增加成本,而且北斗系统需要更换硬件,这非常麻烦。由于日本国土面积小,四颗卫星就足够了。如果使用中国或美国,可能需要35-40颗卫星。国内大多数制造商使用GPS RTK进行绝对定位,但RTK的缺点也很明显。RTK在确定整周模糊度方面的可靠性为95~99%,在稳定性方面不如全站仪,因为RTK容易受到卫星条件、天气条件和数据链路传输条件的影响。首先,每天(在中国通常是下午)中、低纬度地区总有两个GPS盲点,每次持续20~30分钟。卫星几何结构在盲点处的强度较低,因此RTK测量很难得到固定的解。其次,在白天的中午,由于电离层干扰,共享卫星的数量较少,因此初始化甚至初始化需要很长时间,无法测量。根据实践经验,RTK测量每天12:00至13:00很难得到固定的解。第三,依靠GPS信号,它不能在隧道和高层地区使用。阿波罗的先进定位技术无人车方案不能完全基于RTK。百度Apollo系统采用激光雷达、RTK和IMU融合的方案,多个传感器的融合和误差状态卡尔曼滤波器使定位精度达到5-10厘米,具有高可靠性和鲁棒性,达到世界顶级水平。城市地区的最高允许速度超过每小时60公里。

ta“src=”/eimg/jndp/ig/20230304013732503791/1.jpg“/>

上图为百度Apollo自动驾驶传感器、计算单元和控制前的连接图。该计算系统使用省Neousys Nuvo-6108GC工业计算机,该计算机使用英特尔双核E5-2658 V3 12核CPU。它主要用于处理激光雷达云点和图像数据。在GPS定位和惯性测量单元方面,IMU为NovAtel IMU-IGM-A1,GPS接收器为NovAtelProPak6。激光雷达采用Velodyne HDL-64S3,通过以太网与工业计算机相连。水平视场为360,垂直视场为26.9,水平角分辨率为0.08,距离精度小于2厘米。它可以探测1.2亿辆汽车或树木。视觉系统使用Leopard Imaging Li USB 30-Ar023 ZWDR,带3.0外壳,通过USB连接到工业计算机。使用Anson的200万像素1080p传感器AR0230AT和AP0202 ISP。视场宽度为58度,有效距离约为60-70米。毫米波雷达采用大陆ARS408-21,与CAN卡相连。CAN卡为德国ESD CAN PCIe/402-B4。

上图显示了百度无人车定位模块的框架,该模块结合了IMU、GNSS和激光雷达等传感器(紫色)和预先制作的定位图(黄色)。最顶层是SINS系统,即捷联惯性导航系统。捷联惯性导航系统是在平台惯性导航系统的基础上发展起来的。它是一个无框架系统,由三个速率陀螺仪、三个线性加速度计和一个处理器组成。SINS对IMU测量的加速度和角速度进行积分,得到位置、速度和姿态,作为卡尔曼滤波器传播阶段的预测模型。因此,卡尔曼滤波器将校正IMU的加速度和角速度,并且位置、速度和姿态等误差也将反馈给SINS。RTK定位和激光雷达点云定位的结果被用作卡尔曼滤波器的测量更新。

上图为百度的激光雷达点云定位图。首先,要提前制作无人车行驶区域的激光雷达点云定位图,包括激光雷达的强度成像图和高度分布图。该地图通常由地图制造商使用测绘级激光雷达完成。目前,世界上绝大多数制造商,包括Waymo、Ford、GM等。B是激光雷达反射强度的成像图,C是高度分布图。这张地图的面积为3.3*3.1平方公里。激光点云定位算法描述如下:

从表面上看,高精度定位非常复杂。在实际计算中,消耗的计算资源并不多,基于激光雷达的计算量远低于基于图像的计算量。未来,该系统也可以用传统的汽车SoC来完成,如瑞萨的R-Car H3、恩智浦的I.MX8或S32A258C。预计成本将大大降低。64线激光雷达也有望在未来被闪光固态激光雷达所取代,从而大大降低成本。百度无人车定位团队的一篇学术论文《基于多传感器融合的多样化城市场景下稳健精确的车辆定位》已被顶级机器人大会ICRA 2018聘用,初稿可从arXiv下载。Apollo的感知技术Apollo中的感知模块具有以下功能:检测目标(是否有障碍物)、对目标进行分类(障碍物是什么)、语义分割(对整个帧中的障碍物进行分类和渲染)以及目标跟踪(障碍物跟踪)。

Apollo 2.0系统利用多传感器融合做环境感知,摄像头负责红绿灯的检测,毫米波雷达最大的作用是提供目标的移动速度,目标识别主要由激光雷达完成。2016年10月,百度和清华联合发表了一篇题为《自动驾驶多视图三维物体检测网络》的论文,位于https://arxiv.org/pdf/1611.07759.pdf.本文使用激光雷达和相机的融合来……

确定目标。然而,在百度2017年5月发表的一篇论文《使用生产网络的3D激光雷达车辆检测》中,https://arxiv.org/pdf/1608.07916.pdf,放弃了与摄像头的集成。2017年10月,增加了毫米波雷达融合。2017年11月,苹果公司发表了一篇论文《体素网:仅使用激光雷达识别目标的基于点云的三维物体检测的端到端学习》,并将其与百度和清华多视图自动驾驶三维物体检测网络进行了比较,表明单用激光雷达的效果更好。原因是激光雷达的数据处理速度比相机快,时间同步非常困难,两者的坐标需要统一;

其次,相机对光线太敏感,可靠性低,尤其是在长距离拍摄时。在Apollo 2.0中,百度使用了激光雷达和毫米波雷达的融合方案。

激光雷达物体识别的最大优点是,无论白天还是晚上,无论是林荫大道还是光线急剧变化的隧道出口,都可以完全消除光线的干扰。其次,激光雷达可以很容易地获得深度信息,这对摄像系统来说是非常困难的。再次,激光雷达的有效距离远高于摄像头,进一步的有效距离等于增加了安全冗余。最后,在进行深度学习目标识别时,激光雷达的3D云点和相机的2D图像容易出现透视失真。简单地说,透视变形是指一个物体及其周围区域与标准镜头中看到的完全不同,并且由于远近特征的相对比例的变化而弯曲或变形。这是透镜的固有特性(凸透镜聚光,凹透镜发散),因此无法消除,只能改进。这个问题在3D中不存在,因此用于3D图像深度学习的神经网络可以更简单。此外,激光雷达还可以识别颜色和车道线。无人车领域目标图像的识别不仅仅是识别,还包括分割和跟踪。分割是用一个对象框住目标。对于2D图像,只能使用2D帧来分割目标,而激光雷达图像可以是3D帧,这更安全。跟踪是预测车辆或行人可能的轨迹。

显然,3D分割帧比2D分割帧更有价值,这也是Waymo和百度都使用激光雷达识别车辆的原因之一。DPM早期被用于目标检测和识别领域。2013年11月,目标检测领域公认的大神Ross Girschick推出了R-CNN,并于2015年4月演变为Fast R-CNN,2015年6月演变为Fast R-CNN。它已经成为当今目标检测和识别领域公认的最佳方法,并且可以完全实现端到端。FasterR-CNN也用于激光雷达的目标探测和识别。自2015年底以来,Faster R-CNN已经过去了近两年,但它仍然是ObjectDetection领域的主流框架之一。尽管已经引入了改进的框架,如R-FCN和Mask R-CNN,但基本结构没有太大变化。同时,还有许多新作品,如SSD和YOLO,但Faster R-CNN在准确性方面仍然是最好的。从本文中的RCNN到快速RCNN,再到fast RCNN,目标检测的四个基本步骤(候选区域生成、特征提取、分类和位置细化)最终统一为一个深度网络框架。所有计算都不重复,完全在GPU中完成,大大提高了运行速度。 4

4

图像语义分割可以说是图像理解的基石技术,在自动驾驶系统(具体而言,街景识别和理解,判断驾驶区域)、无人机应用(着陆点判断)和可穿戴设备应用中发挥着重要作用。图像由许多像素组成,顾名思义,“语义分割”是根据图像中表达的不同语义对像素进行分组/分割。语义分割有时是最困难的部分,因为它需要NLP自然语言处理的技能,而大多数玩CNN的人对NLP不是很了解。

5

5

上图为斯坦福大学激光雷达语义分割的流程图。最后,使用3D FC-RF,即完全连接的条件随机场。另一种常用的方法是MRF和马尔可夫随机场。将条件随机场用于自然语言处理,如序列标记和数据分割,取得了良好的效果。它在中文分词、中文名称识别和歧义解决等方面都有应用。百度的语义分割主要是为了更好地理解流量场景,为行为决策提供依据。低成本unm……

ned驾驶还可以使用相机的2D图像进行语义分割,以找出无人车的驾驶区域。这种低成本的方案可以在光线好的情况下使用。除了激光雷达,2018年CES展出的Apollo2.0无人车顶部增加了两个摄像头,一个长焦和一个短焦,主要用于识别道路上的红绿灯。自动驾驶训练数据集KITTI数据集是由德国卡尔斯鲁厄理工学院和丰田美国理工学院共同创立的自动驾驶场景中的计算机视觉算法评估数据集。该数据集用于评估计算机视觉技术在车辆环境中的性能,如立体图像、光流、视觉里程计、3D物体检测和3D跟踪。KITTI包含从城市、农村和高速公路场景中收集的真实图像数据,每张图像中最多有15辆汽车和30名行人,以及不同程度的遮挡和截断。

6

6

Cityscapes数据集主要由梅赛德斯-奔驰公司推广,提供无人环境下的图像分割数据集。它用于评估视觉算法在城市场景语义理解方面的性能。城市景观包含了50个城市不同场景、背景和季节的街景,提供了5000张精细标记的图像、20000张粗略标记的图像和30种标记的物体。3月8日,百度正式开放ApolloScape大型自动驾驶数据集。ApolloScape的数据是Cityscapes等类似数据集的10倍以上,包括感知、模拟场景和路网数据等数十万高分辨率图像数据,这些数据被逐像素进行语义分割和标记,进一步覆盖了更复杂的环境、天气和交通状况。ApolloScape数据集涵盖了更复杂的道路条件,例如单个图像中多达162辆车辆或80名行人,开放数据集采用逐像素的语义分割和标记。Kitti、Cityscapes和ApoloScape的数据示例比较

7

7

对于中国的传统汽车制造商来说,自建培训数据集可能是最大的问题,与百度合作是最好的选择。3月31日,北京“你好Apollo,自动驾驶公开课”在2018年CES上,百度发布了Apollo 2.0,搭载百度Apollo 2.0-系统的自动驾驶汽车将具备简单城市道路的自动驾驶能力。Apollo 2.0的发布也意味着百度的整体自动驾驶系统已经开放,包括云服务平台、软件平台、参考硬件平台和参考车辆平台。阿波罗自动驾驶公开课程第三期将于3月31日在北京举行,将引导自动驾驶开发者深入应用Apollo2.0。本次公开课邀请了百度自动驾驶部门的高级工程师和Apollo的老用户与开发者交流,快速掌握Apollo2.0的最新功能。负责产品解决方案的百度自动驾驶事业部高级架构师杨帆将介绍Apollo开放平台的引入、Apollo能力开放、Apollon资源开放和研发迭代的新模式以及Apollo生态舞台的成果。设计并建造Apollo多传感器融合定位系统的百度无人车定位技术负责人万国伟将介绍Apollo2.0多传感器融合导航模块。无人车定位技术是自动驾驶领域的基础技术之一,其难点在于如何保证高精度和高鲁棒性。Apollo2.0的多传感器融合定位模块自适应地使用GNSS、激光雷达和IMU等传感器,并在许多具有挑战性的场景(如城市地区和隧道)中实现厘米级定位。万国伟的演讲将分享定位模块的框架以及每个子模块的算法原理。长沙智能驾驶研究院产品部负责人黄英军从事智能驾驶的整体解决方案和产品研发,并将在沙龙上介绍“Apollo分布式可扩展计算平台的探索”。黄英俊的分享主要包括:Jetson TX2上的Docker扩展和运行Apollo

; 在Jetson TX2上的Apollo中配置了TensorRT和VisionWorks的自适应功能,以优化和加速视觉算法。智行哲科技联合创始人&;技术研发部总监李晓飞将在沙龙上分享“智能驾驶员案例——阿波罗合作落地低速自动驾驶专用车产品”,主要包括自动驾驶落地场景和应用挑战、智能驾驶员AVOS系统的研发、,以及Intelligent Driver与Apollo之间的技术合作。

8

8

9

9

演讲者简介

0

0

杨帆:百度自动驾驶事业部高级架构师,负责产品解决方案。演讲摘要:阿波罗开放平台介绍、阿波罗能力开放介绍、阿波罗资源开放和研发迭代新模式、阿波罗生态阶段成果。

1

1

万国伟:百度无人车定位技术和Apollo核心算法技术负责人,设计并构建了Apollo多传感器融合定位系统。摘要:无人车定位技术是自动驾驶领域的基础技术之一,其难点在于如何保证高精度和高鲁棒性。Apollo2.0的多传感器融合定位模块自适应地使用GNSS、激光雷达和IMU等传感器,并在许多具有挑战性的场景(如城市地区和隧道)中实现厘米级定位。本次讲座将分享定位模块的框架以及每个子模块的算法原理。

2

2

黄英军:长沙市智能驾驶研究院产品部部长,从事智能驾驶整体解决方案和产品研发,探索Apollo的分布式扩展。摘要:随着智能驾驶技术平台和系统架构的快速发展,许多制造商都提出了自己的系统架构和解决方案,但目前还没有占主导地位的解决方案。Apollo集中运行感知、决策和控制模块,对资源、实时性能和可靠性有不同要求,对计算平台、操作系统和运行环境也有不同要求。我们共享的是,这些模块是解耦的,并以分布式和集成的方式在不同的计算平台和操作系统上运行,即决策和控制模块在高度可靠的双机备份低成本平台上运行,并且传感模块在几个低成本和高性能的技术平台上运行,以实现分布式和可扩展的解决方案。这种共享主要包括:Jetson TX2上的Docker扩展和运行Apollo

; 在Jetson TX2上的Apollo中配置了TensorRT和VisionWorks的自适应功能,以优化和加速视觉算法。

3

3

李晓飞:智行哲科技联合创始人;

技术研发部部长。演讲摘要:自动驾驶产品落地为何如此困难?困惑,自动驾驶应用场景的出路在哪里?团结就是力量,智者和阿波罗怎么能齐头并进?本文主要介绍了自动驾驶着陆场景及应用挑战、智能步行者AVOS系统的研发以及智能步行者与Apollo的技术合作三个部分。

4 2013年11月,目标检测领域公认的大神Ross Girschick推出了R-CNN,并于2015年4月演变为Fast R-CNN,2015年6月演变为Fast R-CNN。它已经成为当今目标检测和识别领域公认的最佳方法,并且可以完全实现端到端。FasterR-CNN也用于激光雷达的目标探测和识别。自2015年底以来,Faster R-CNN已经过去了近两年,但它仍然是ObjectDetection领域的主流框架之一。尽管已经引入了改进的框架,如R-FCN和Mask R-CNN,但基本结构没有太大变化。同时,还有许多新作品,如SSD和YOLO,但Faster R-CNN在准确性方面仍然是最好的。从本文中的RCNN到快速RCNN,再到fast RCNN,目标检测的四个基本步骤(候选区域生成、特征提取、分类和位置细化)最终统一为一个深度网络框架。所有计算都不重复,完全在GPU中完成,大大提高了运行速度。

4 2013年11月,目标检测领域公认的大神Ross Girschick推出了R-CNN,并于2015年4月演变为Fast R-CNN,2015年6月演变为Fast R-CNN。它已经成为当今目标检测和识别领域公认的最佳方法,并且可以完全实现端到端。FasterR-CNN也用于激光雷达的目标探测和识别。自2015年底以来,Faster R-CNN已经过去了近两年,但它仍然是ObjectDetection领域的主流框架之一。尽管已经引入了改进的框架,如R-FCN和Mask R-CNN,但基本结构没有太大变化。同时,还有许多新作品,如SSD和YOLO,但Faster R-CNN在准确性方面仍然是最好的。从本文中的RCNN到快速RCNN,再到fast RCNN,目标检测的四个基本步骤(候选区域生成、特征提取、分类和位置细化)最终统一为一个深度网络框架。所有计算都不重复,完全在GPU中完成,大大提高了运行速度。 4

4

图像语义分割可以说是图像理解的基石技术,在自动驾驶系统(具体而言,街景识别和理解,判断驾驶区域)、无人机应用(着陆点判断)和可穿戴设备应用中发挥着重要作用。图像由许多像素组成,顾名思义,“语义分割”是根据图像中表达的不同语义对像素进行分组/分割。语义分割有时是最困难的部分,因为它需要NLP自然语言处理的技能,而大多数玩CNN的人对NLP不是很了解。

5

5

上图为斯坦福大学激光雷达语义分割的流程图。最后,使用3D FC-RF,即完全连接的条件随机场。另一种常用的方法是MRF和马尔可夫随机场。将条件随机场用于自然语言处理,如序列标记和数据分割,取得了良好的效果。它在中文分词、中文名称识别和歧义解决等方面都有应用。百度的语义分割主要是为了更好地理解流量场景,为行为决策提供依据。低成本无人驾驶还可以利用摄像头的2D图像进行语义分割,找出无人车的驾驶区域。这种低成本的方案可以在光线好的情况下使用。除了激光雷达,2018年CES展出的Apollo2.0无人车顶部增加了两个摄像头,一个长焦和一个短焦,主要用于识别道路上的红绿灯。自动驾驶训练数据集KITTI数据集是由德国卡尔斯鲁厄理工学院和丰田美国理工学院共同创立的自动驾驶场景中的计算机视觉算法评估数据集。该数据集用于评估计算机视觉技术在车辆环境中的性能,如立体图像、光流、视觉里程计、3D物体检测和3D跟踪。KITTI包含从城市、农村和高速公路场景中收集的真实图像数据,每张图像中最多有15辆汽车和30名行人,以及不同程度的遮挡和截断。

6

6

Cityscapes数据集主要由梅赛德斯-奔驰公司推广,提供无人环境下的图像分割数据集。它用于评估视觉算法在城市场景语义理解方面的性能。城市景观包含了50个城市不同场景、背景和季节的街景,提供了5000张精细标记的图像、20000张粗略标记的图像和30种标记的物体。3月8日,百度正式开通ApolloScape大型sc……

e自动驾驶仪数据集。ApolloScape的数据是Cityscapes等类似数据集的10倍以上,包括感知、模拟场景和路网数据等数十万高分辨率图像数据,这些数据被逐像素进行语义分割和标记,进一步覆盖了更复杂的环境、天气和交通状况。ApolloScape数据集涵盖了更复杂的道路条件,例如单个图像中多达162辆车辆或80名行人,开放数据集采用逐像素的语义分割和标记。Kitti、Cityscapes和ApoloScape的数据示例比较

7

7

对于中国的传统汽车制造商来说,自建培训数据集可能是最大的问题,与百度合作是最好的选择。3月31日,北京“你好Apollo,自动驾驶公开课”在2018年CES上,百度发布了Apollo 2.0,搭载百度Apollo 2.0-系统的自动驾驶汽车将具备简单城市道路的自动驾驶能力。Apollo 2.0的发布也意味着百度的整体自动驾驶系统已经开放,包括云服务平台、软件平台、参考硬件平台和参考车辆平台。阿波罗自动驾驶公开课程第三期将于3月31日在北京举行,将引导自动驾驶开发者深入应用Apollo2.0。本次公开课邀请了百度自动驾驶部门的高级工程师和Apollo的老用户与开发者交流,快速掌握Apollo2.0的最新功能。负责产品解决方案的百度自动驾驶事业部高级架构师杨帆将介绍Apollo开放平台的引入、Apollo能力开放、Apollon资源开放和研发迭代的新模式以及Apollo生态舞台的成果。设计并建造Apollo多传感器融合定位系统的百度无人车定位技术负责人万国伟将介绍Apollo2.0多传感器融合导航模块。无人车定位技术是自动驾驶领域的基础技术之一,其难点在于如何保证高精度和高鲁棒性。Apollo2.0的多传感器融合定位模块自适应地使用GNSS、激光雷达和IMU等传感器,并在许多具有挑战性的场景(如城市地区和隧道)中实现厘米级定位。万国伟的演讲将分享定位模块的框架以及每个子模块的算法原理。长沙智能驾驶研究院产品部负责人黄英军从事智能驾驶的整体解决方案和产品研发,并将在沙龙上介绍“Apollo分布式可扩展计算平台的探索”。黄英俊的分享主要包括:Jetson TX2上的Docker扩展和运行Apollo

; 在Jetson TX2上的Apollo中配置了TensorRT和VisionWorks的自适应功能,以优化和加速视觉算法。智行哲科技联合创始人&;技术研发部总监李晓飞将在沙龙上分享“智能驾驶员案例——阿波罗合作落地低速自动驾驶专用车产品”,主要包括自动驾驶落地场景和应用挑战、智能驾驶员AVOS系统的研发、,以及Intelligent Driver与Apollo之间的技术合作。

8

8

9

9

演讲者简介

0

0

杨帆:百度自动驾驶事业部高级架构师,负责产品解决方案。演讲摘要:阿波罗开放平台介绍、阿波罗能力开放介绍、阿波罗资源开放和研发迭代新模式、阿波罗生态阶段成果。

1

1

万国伟:百度无人车定位技术和Apollo核心算法技术负责人,设计并构建了Apollo多传感器融合定位系统。摘要:无人车定位技术是自动驾驶领域的基础技术之一,其难点在于如何保证高精度和高鲁棒性。Apollo2.0的多传感器融合定位模块自适应地使用GNSS、激光雷达和IMU等传感器,并在许多具有挑战性的场景(如城市地区和隧道)中实现厘米级定位。本次讲座将分享定位模块的框架以及每个子模块的算法原理。

2

2

黄英军:长沙市智能驾驶研究院产品部部长,从事智能驾驶整体解决方案和产品研发,探索Apollo的分布式扩展。摘要:随着智能驾驶技术平台和系统架构的快速发展,许多制造商都提出了自己的系统架构和解决方案,但目前还没有占主导地位的解决方案。Apollo集中运行感知、决策和控制模块,对资源、实时性能和可靠性有不同要求,对计算平台、操作系统和运行环境也有不同要求。我们共享的是,这些模块是解耦的,并以分布式和集成的方式在不同的计算平台和操作系统上运行,即决策和控制模块在高度可靠的双机备份低成本平台上运行,并且传感模块在几个低成本和高性能的技术平台上运行,以实现分布式和可扩展的解决方案。这种共享主要包括:Jetson TX2上的Docker扩展和运行Apollo;在Jetson TX2上的Apollo中配置了TensorRT和VisionWorks的自适应功能,以优化和加速视觉算法。

3

3

李晓飞:智行哲科技联合创始人;技术研发部部长。演讲摘要:自动驾驶产品落地为何如此困难?困惑,自动驾驶应用场景的出路在哪里?团结就是力量,智者和阿波罗怎么能齐头并进?本文主要介绍了自动驾驶着陆场景及应用挑战、智能步行者AVOS系统的研发以及智能步行者与Apollo的技术合作三个部分。

4

4

3月21日,宝马集团在德国慕尼总部召开了每年一度的全球年会,就财报的关键数字、未来规划和全球市场的布局发布了一系列重要数据和关键信息。

1900/1/1 0:00:003月21日,亿欧汽车在位于北京理工大学中关村校区国防科技园的新能源汽车国家监测与管理中心办公区前,遇到了三位法拉第未来(FF)的工作人员。

1900/1/1 0:00:003月21日,吉利汽车控股有限公司发布了2017年全年财报公告,截至2017年12月31日,吉利汽车总营收92761亿元,同比增长73,此前市场预估9426亿元;全年净利润106

1900/1/1 0:00:00A轮5亿元融资的消息公布后,亿欧汽车在位于学院南路的行圆汽车总部见到了行圆的创始人兼CEO邵京宁。

1900/1/1 0:00:00根据英国《金融时报》研究服务部门《投资参考》的最新调查,尽管目前本土品牌仍主导中国电动汽车市场,但未来可不见得如此。由于中国政府鼓励发展电动汽车行业而引发的“淘金热”,或将导致行业大洗牌。

1900/1/1 0:00:00坐落于宁波市慈溪市杭州湾的吉利汽车(杭州湾)研发中心规划于2013年,2016年正式投入使用。

1900/1/1 0:00:00